ABSTRACT

This study assessed the accuracy and reliability of a 2D image-based deep learning algorithm for posture analysis by comparing it with a 3D motion capture system. Twenty healthy adult males participated, and nine balance parameters were measured using both methods: body tilt (ML/AP), shoulder tilt, pelvis tilt (ML/AP), knee tilt, left/right varus/valgus, and forward head posture. We evaluated agreement and reliability using root mean square error (RMSE), mean absolute error (MAE), Pearson correlation coefficients, and intraclass correlation coefficients (ICC). Most parameters exhibited RMSE and MAE within 3°, while forward head posture, pelvis tilt (AP), and varus/valgus had errors below 10°. High correlations were found for shoulder tilt (r = 0.886) and forward head posture (r = 0.681), whereas knee tilt and left varus/valgus showed lower correlations due to methodological differences. Both methods demonstrated high repeatability (3D: ICC > 0.90, 2D: ICC > 0.80), with moderate-to-high agreement between methods (ICC ≥ 0.5 for most parameters). Shoulder tilt (ICC = 0.919) and forward head posture (ICC = 0.799) showed particularly high agreement. These findings indicate that 2D image-based posture analysis can provide accurate and reliable assessments comparable to 3D motion capture, presenting a more accessible and cost-effective alternative for posture evaluation in clinical and research contexts.

-

KEYWORDS: Posture analysis, Deep learning, 2D image, 3D human pose estimation, 3D motion capture

-

KEYWORDS: 체형분석, 딥러닝, 2차원 사진, 3차원 인체 자세추정, 3차원 동작분석

1. 서론

COVID-19 팬데믹으로 인한 비대면 활동의 증가로 디지털 기기의 사용 시간이 급격히 늘어났다[

1]. 이에 따라 장시간 컴퓨터 및 스마트폰 등 디지털 기기를 사용하는 인구가 증가하였으며, 이로 인해 VDT 증후군(Visual Display Terminal Syndrome)이 중요한 건강 문제로 대두되고 있다. VDT 증후군은 거북목 증후군, 목 디스크, 손목터널 증후군 등을 포함하는 근골격계 및 신경학적 이상을 유발하는 질환군으로 정의된다[

2]. 건강보험심사평가원의 보고에 따르면, 2019년 기준 근골격계 질환자는 1,761만 명으로, 2009년 대비 7.9%p 증가한 수치이다[

3].

근골격계 질환의 증가는 예방 및 치료의 필요성을 더욱 강조하고 있으며, 이에 따라 근골격계 질환의 평가 방법의 중요성 또한 부각되고 있다. 박정식 등[

4]은 근골격계 질환의 진단 과정에서 촉진 평가 및 자세 평가가 필수적이라고 보고하였다. 이러한 근골격계 질환의 증가로 인해 정확하고 접근성 높은 체형 분석 도구의 필요성이 증가하고 있다. 최근에는 스마트폰과 같은 개인 디지털 기기를 활용한 건강 관리 솔루션이 주목받고 있으며, 체형 분석 분야에서도 이러한 기술을 활용한 연구가 활발히 진행되고 있다. Hong [

5]은 포스트 팬데믹 시대의 모바일 헬스 발전을 분석하면서, 스마트폰과 웨어러블 기기의 기술적 융합이 지속적인 건강 모니터링의 새로운 가능성을 열고 있다고 보고하였다. 또한 He 등[

6]의 문헌계량학적 분석에 따르면, mHealth 관련 연구는 2003년 3편에서 2022년 130편으로 증가하였으며, 특히 2020년 이후 COVID-19의 영향으로 연간 100편 이상의 논문이 발표되는 등 급속한 성장세를 보이고 있다. 이러한 디지털 헬스케어 시장 전체도 지속적으로 성장하고 있으며, Statista의 보고에 따르면 글로벌 디지털 헬스케어 시장은 2 02 9년까지 약 258.3억 달러 규모로 확대될 것으로 전망된다[

7].

기존의 체형 분석 방법으로는 전문가가 수행하는 촉진 평가 방법[

8-

10]과 3차원 동작 분석 시스템을 활용한 방법이 있다[

11-

14]. 그러나 전문가의 촉진 평가 방식은 검사자의 숙련도와 주관성에 영향을 받을 수 있으며, 3차원 동작 분석 시스템은 높은 정확도를 제공하지만, 실험실 환경에서만 사용이 가능하고 마커 부착이 필요하며, 높은 비용과 피부 움직임에 따른 오차가 발생할 수 있다는 한계를 가진다[

15]. 이러한 한계를 보완하기 위해 깊이 카메라(Depth Camera)를 활용한 체형 분석 연구가 진행되었다[

16,

17]. 깊이 카메라는 마커 없이도 3차원 정보를 획득할 수 있는 장점이 있으나, 조명 환경에 민감하고 텍스처가 부족한 영역에서 정확도가 떨어지며, 다중 카메라 사용 시 간섭 문제 등의 기술적 한계를 가진다[

18].

반면, 휴대폰 카메라를 활용한 체형 분석은 기존의 장비보다 접근성이 높으며 장소에 구애받지 않고 사용할 수 있는 장점이 있다. 이에 따라 2D 이미지 기반 체형 분석 연구가 최근 활발히 진행되고 있다. Stamm 등[

19]은 스마트폰으로 촬영한 2D 이미지를 2D 자세 추정 알고리즘(Lindera-v2)에 적용하여 각 관절의 각도를 추정하고, 3차원 동작 분석 시스템 PanopticStudio Toolbox (Carnegie Mellon University, USA)와 비교 분석하였다. 연구 결과, Lindera-v2의 ICC = 0.950-0.997로 매우 높은 일치도를 보였으며, 골반 관절과 오른쪽 어깨 관절의 평균 오차(MAE)는 각각 1.40°, 6.48°로 나타났다. 이나경 등[

20]은 SCHP (Self-Correction for Human Parsing [

21]) 모델을 활용하여 신체 부위를 세분화하고 체형 변화를 정량적으로 분석하였다. 해당 연구에서는 LIP [

22], ATR [

23], Pascal-Person-Part [

24] 데이터셋을 학습하여 모델 성능을 개선하였으며, 실험 결과 평균 IoU 값 83.70을 기록하며 기존 모델 대비 우수한 성능을 보였다.

본 연구에서는 휴대폰 카메라로 촬영한 2D 이미지를 기반으로 9개의 신체 균형 지표(전신 좌우 기울기, 어깨 기울기, 골반 좌우 기울기, 무릎 기울기, 내반슬 및 외반슬, 거북목 각도, 전신 앞뒤 기울기, 골반 앞뒤 기울기)를 측정하고, 이를 3D 동작 분석 시스템의 결과와 정량적으로 비교하였다. 특히 RMSE [

25], MAE [

25], 피어슨 상관계수(Pearson Correlation Coefficient) [

26], 급내상관계수(ICC) [

27]를 종합적으로 활용하여 두 방법 간의 정확도, 상관성, 일치도 및 반복 측정 신뢰도를 체계적으로 평가함으로써, 2D 이미지 기반 체형 분석의 실용성을 검증하고자 하였다.

2. 방법

2.1 실험 대상

본 연구에는 근골격계 질환이 없는 건강한 성인 남성 20명(172.9 ± 5.2 cm, 73.3 ± 9.4 kg, 24.4 ± 1.4세)이 참여하였다. 모든 참여자는 실험 시작 전에 사진 촬영 및 연구 참여에 대한 서면 동의를 제출하였으며, 연세대학교 미래캠퍼스 생명윤리심의위원회의 승인을 받았다(승인번호: 10418419-202412-BM-250-01).

2.2 실험 장비

2.2.1 3D 동작 분석

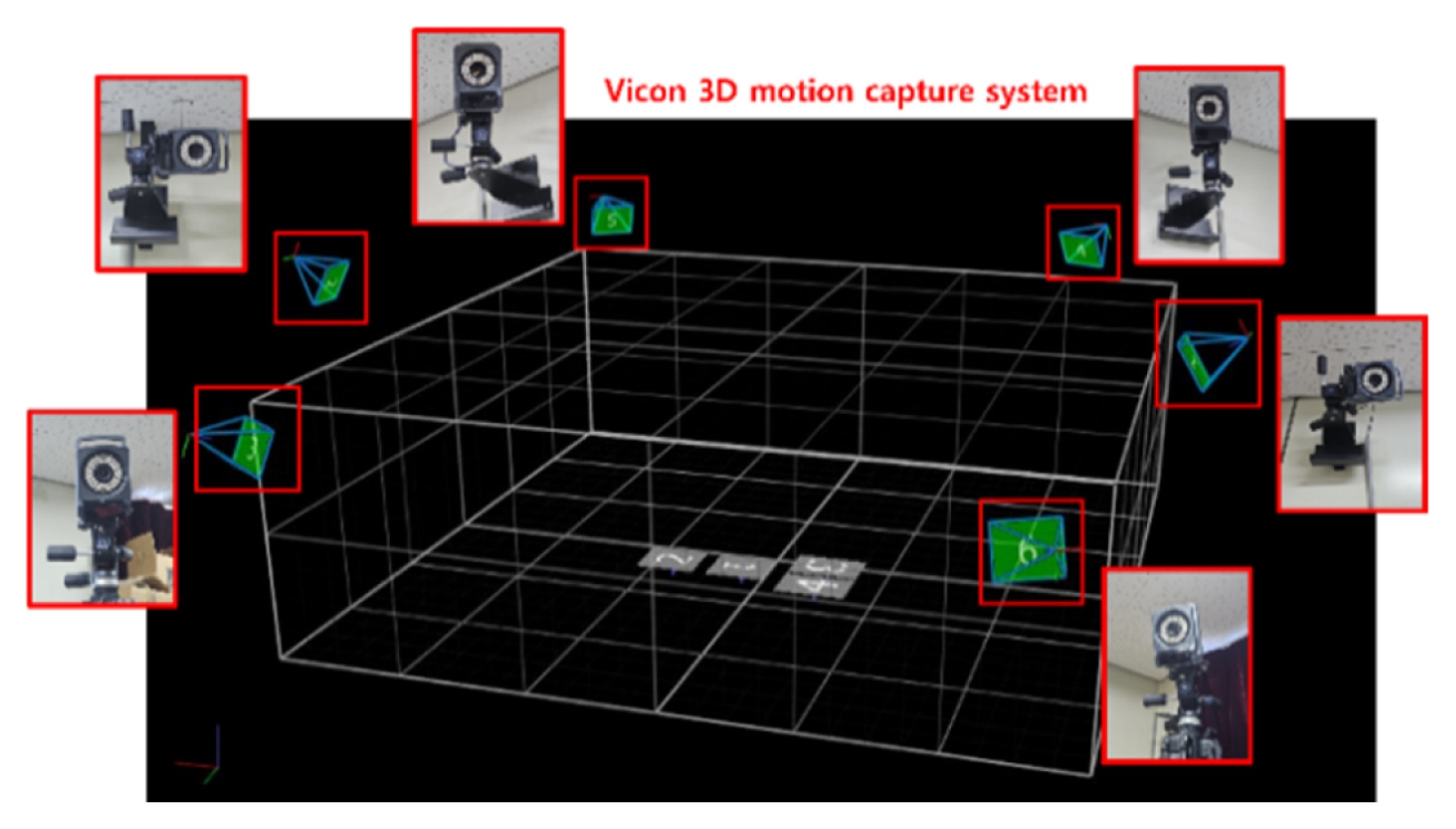

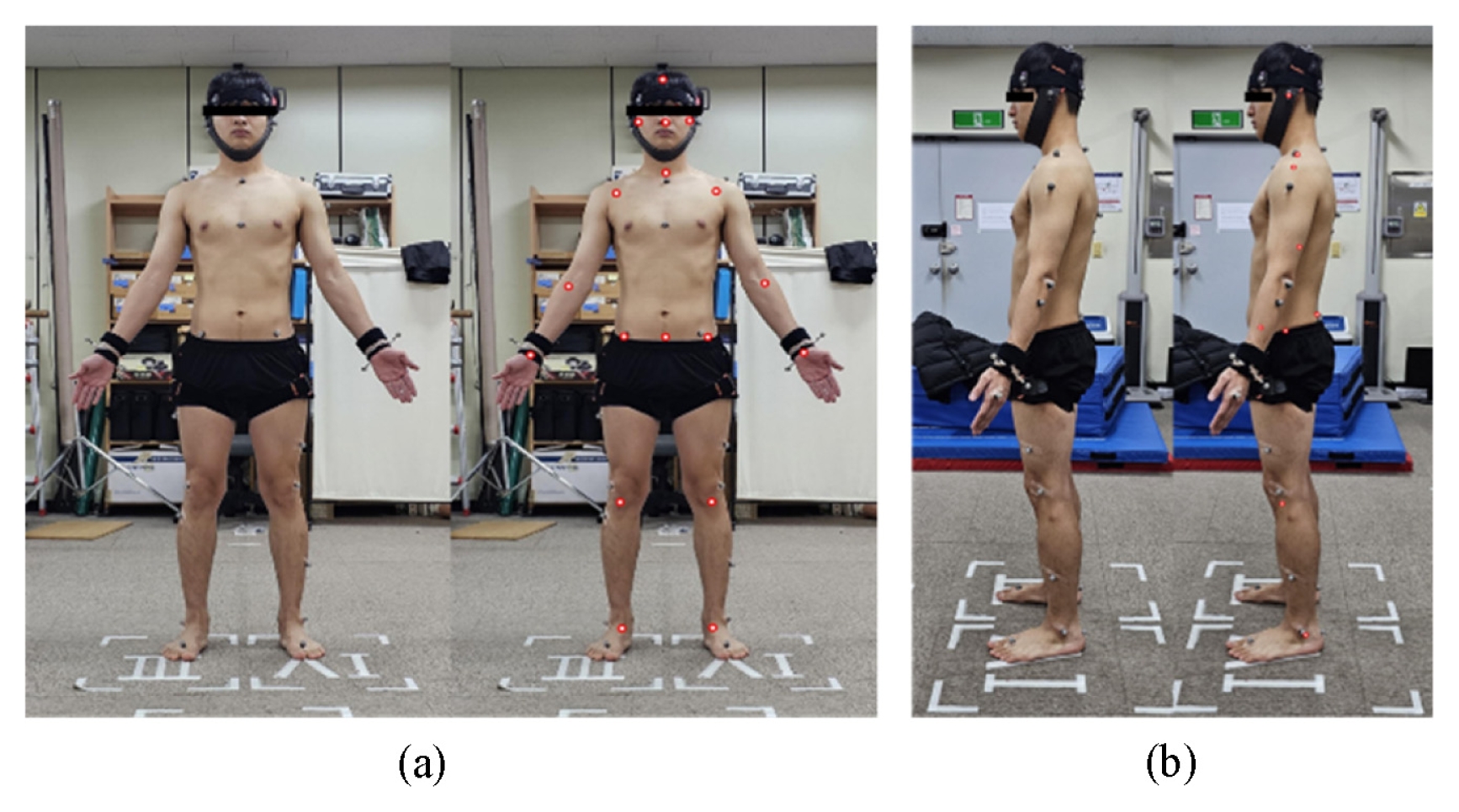

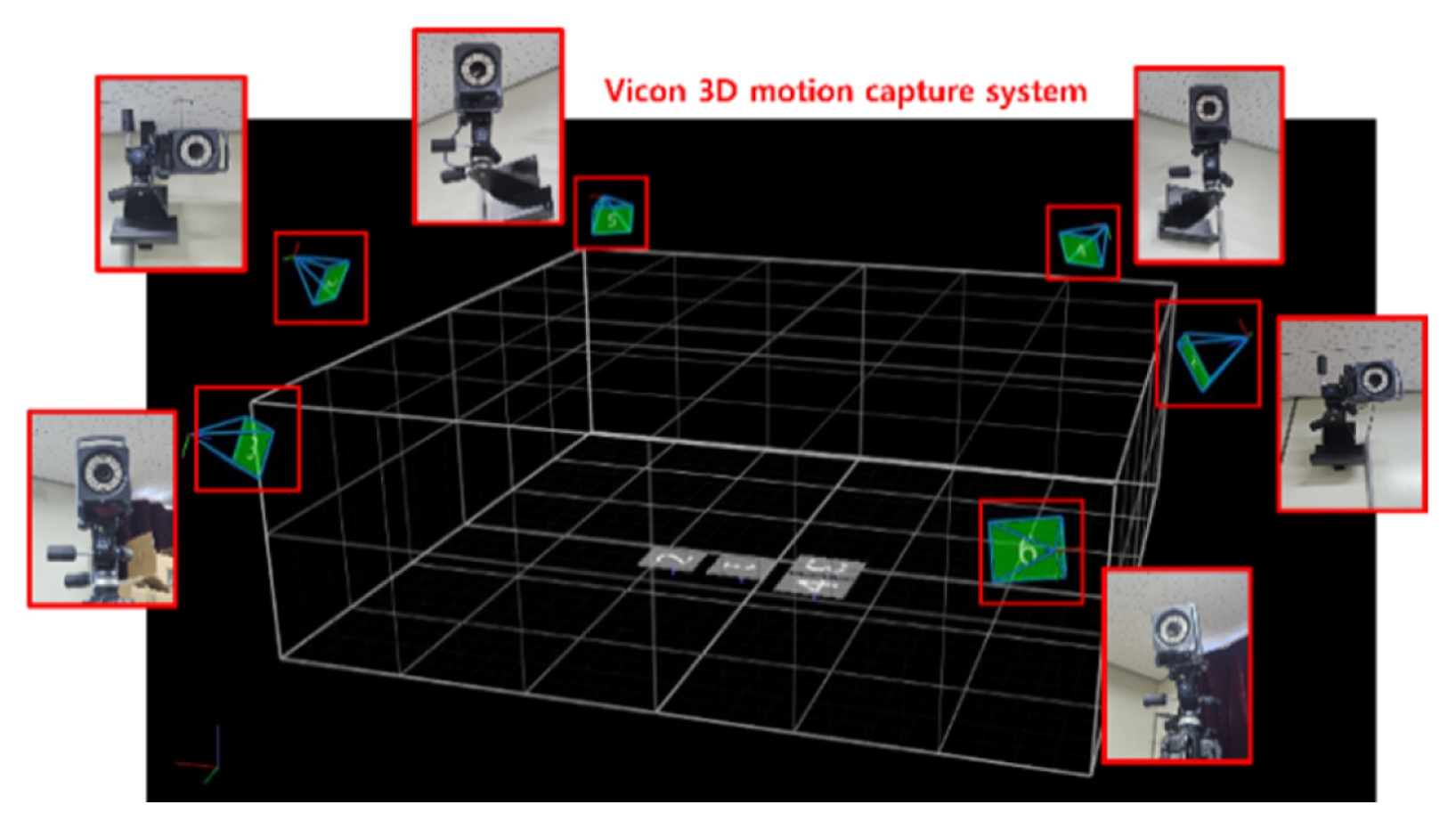

3D 동작 분석 시스템(Vicon Motion System Ltd, UK)을 사용하여 피험자에게 부착된 반사 마커의 3차원 공간(x, y, z)의 좌표를 기록한다.

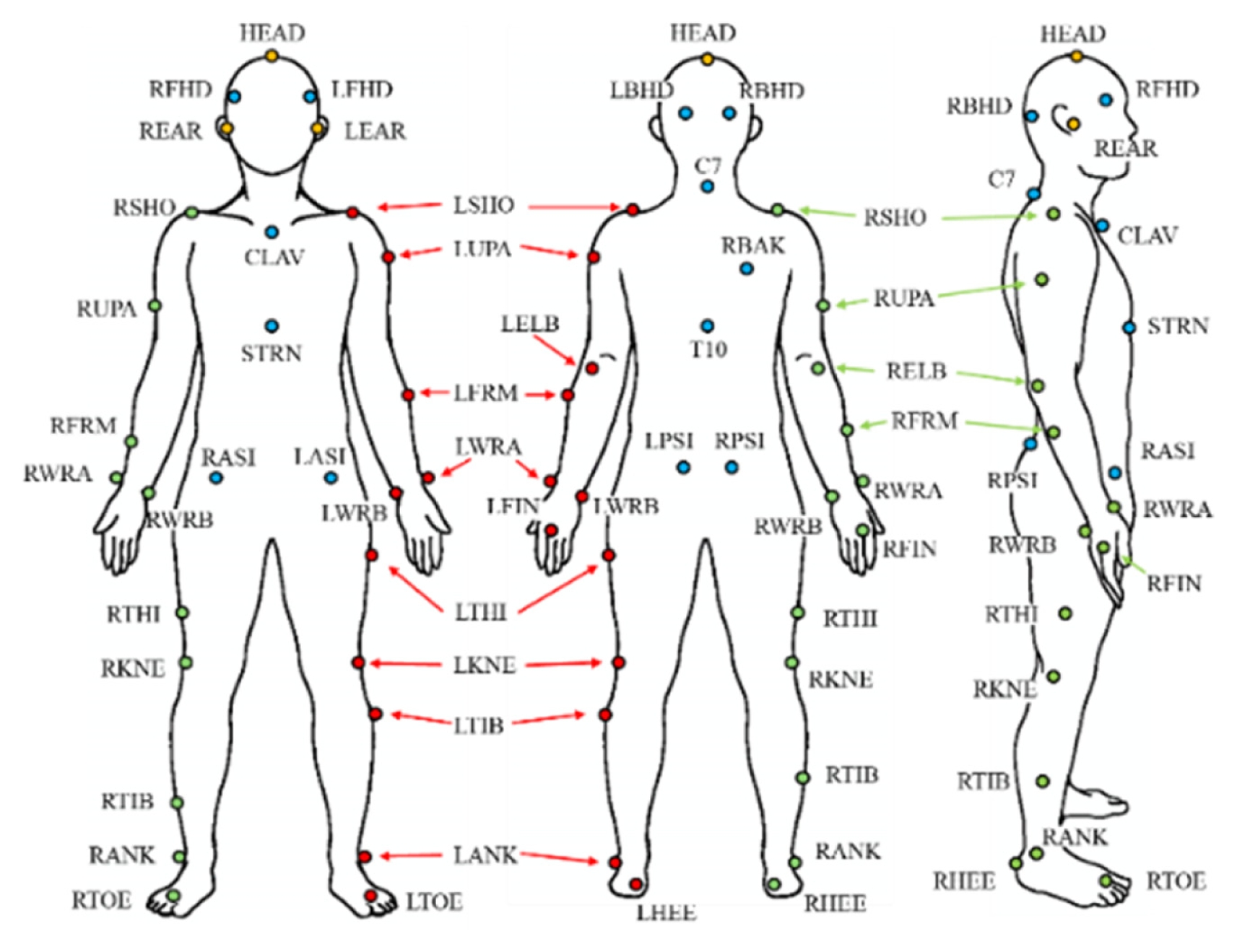

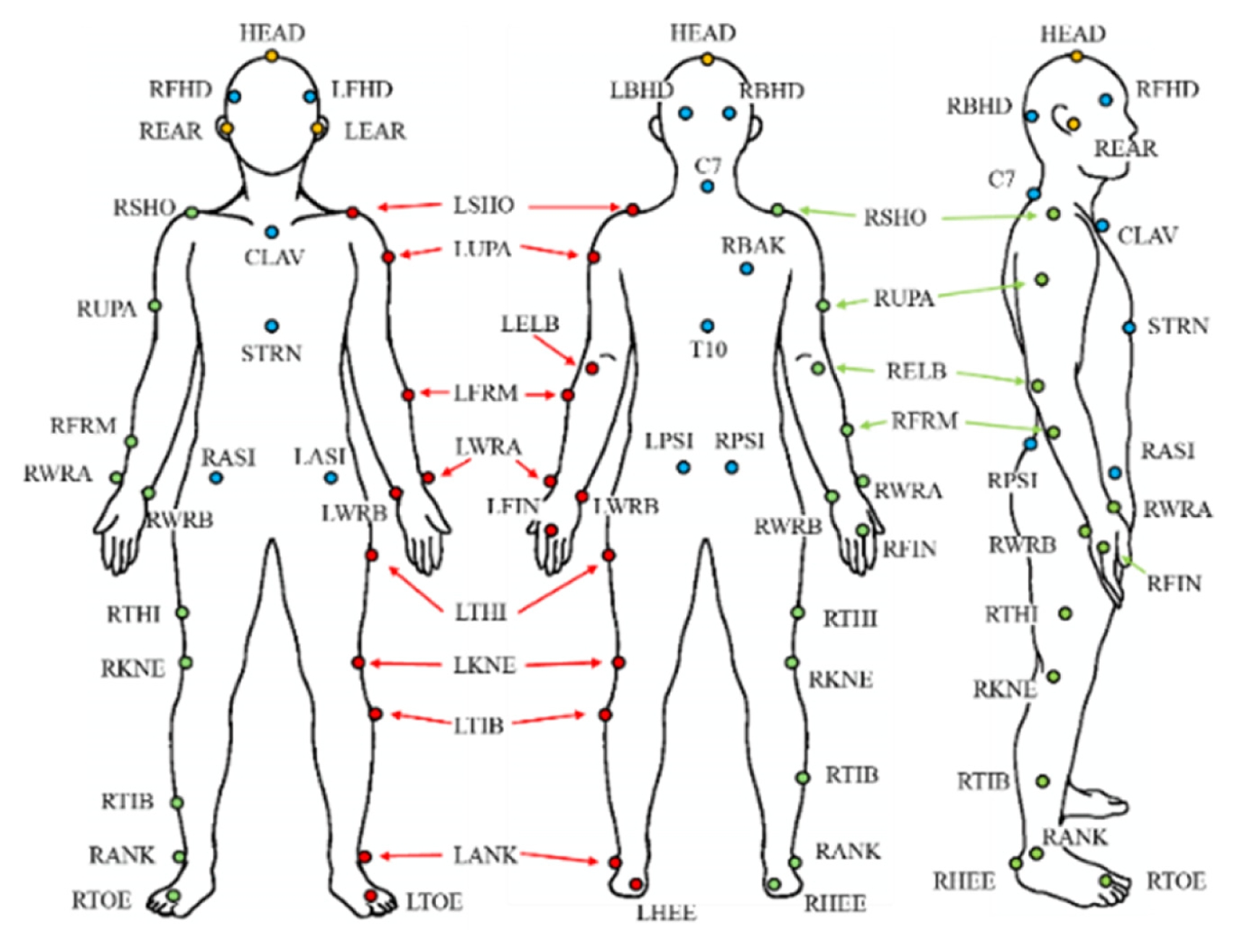

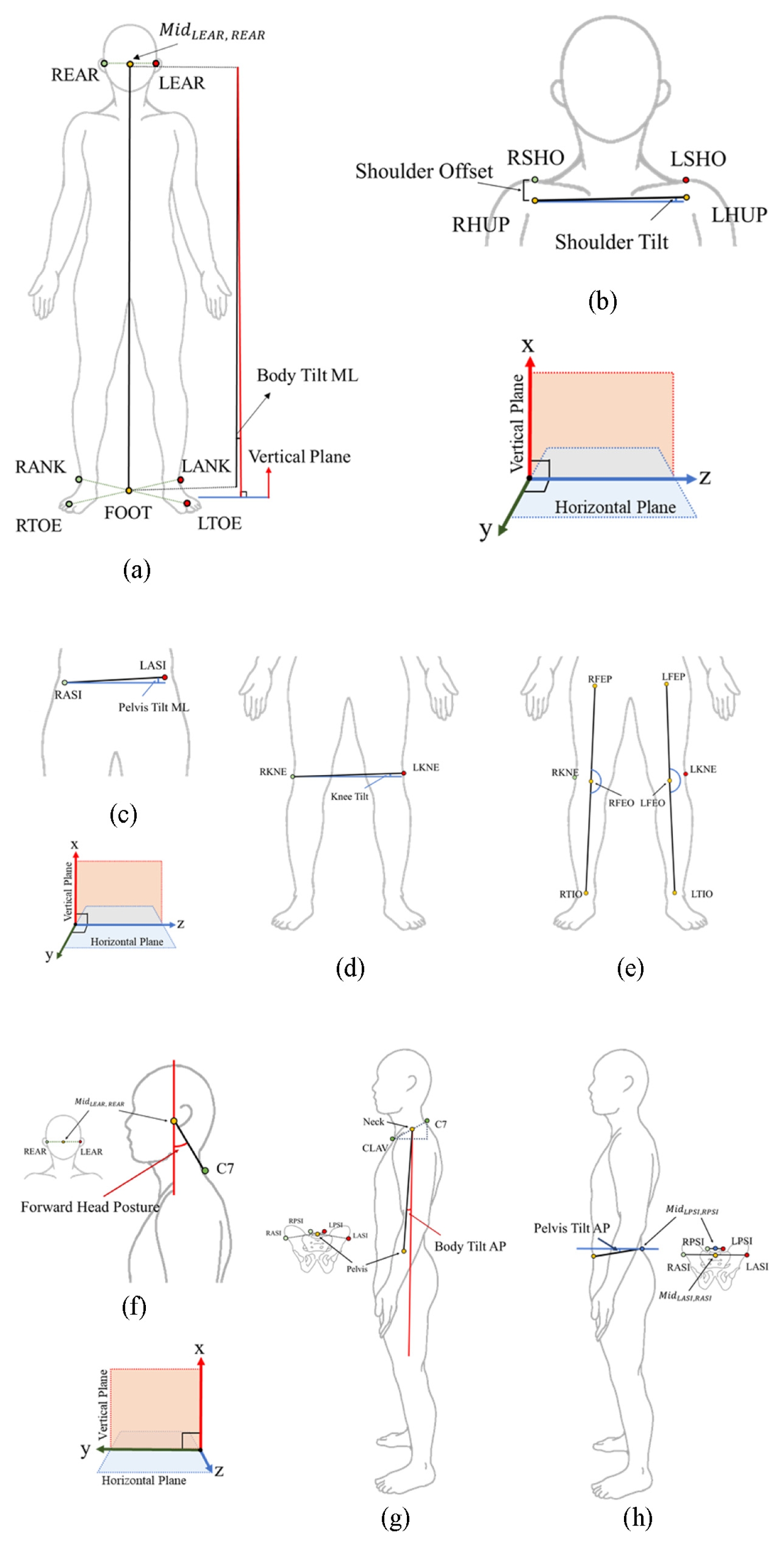

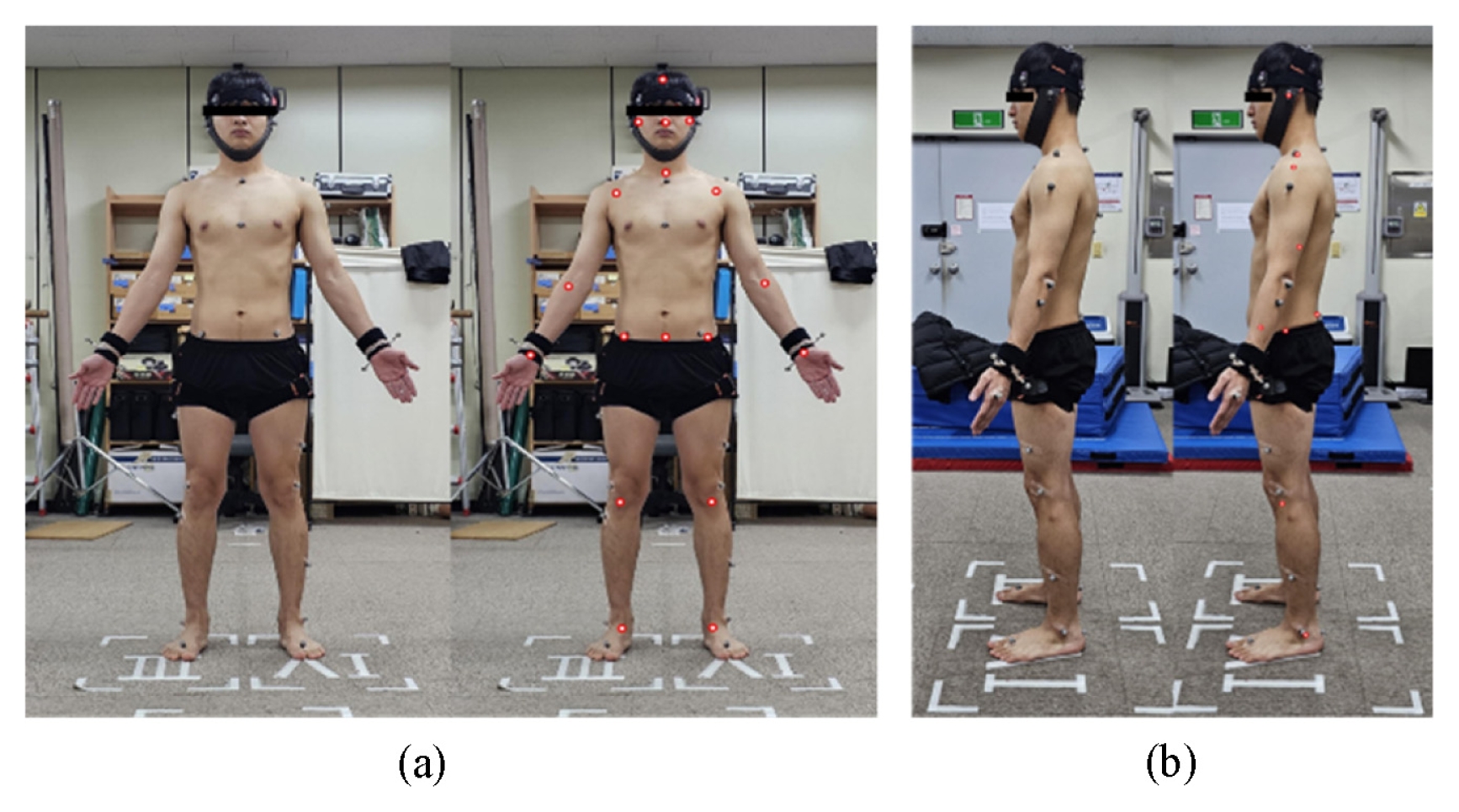

Figs. 1과

2는 각각 피험자에게 부착된 42개의 반사 마커 위치와 6대의 카메라의 위치 및 실험환경을 보여준다. 반사 마커는 Plug-in Gait Marker Set [

28,

29] 기반으로 부착되었으며, 3개의 마커가 피험자의 양쪽 귀, 신체에 가장 높은 지점에 추가로 부착되었다.

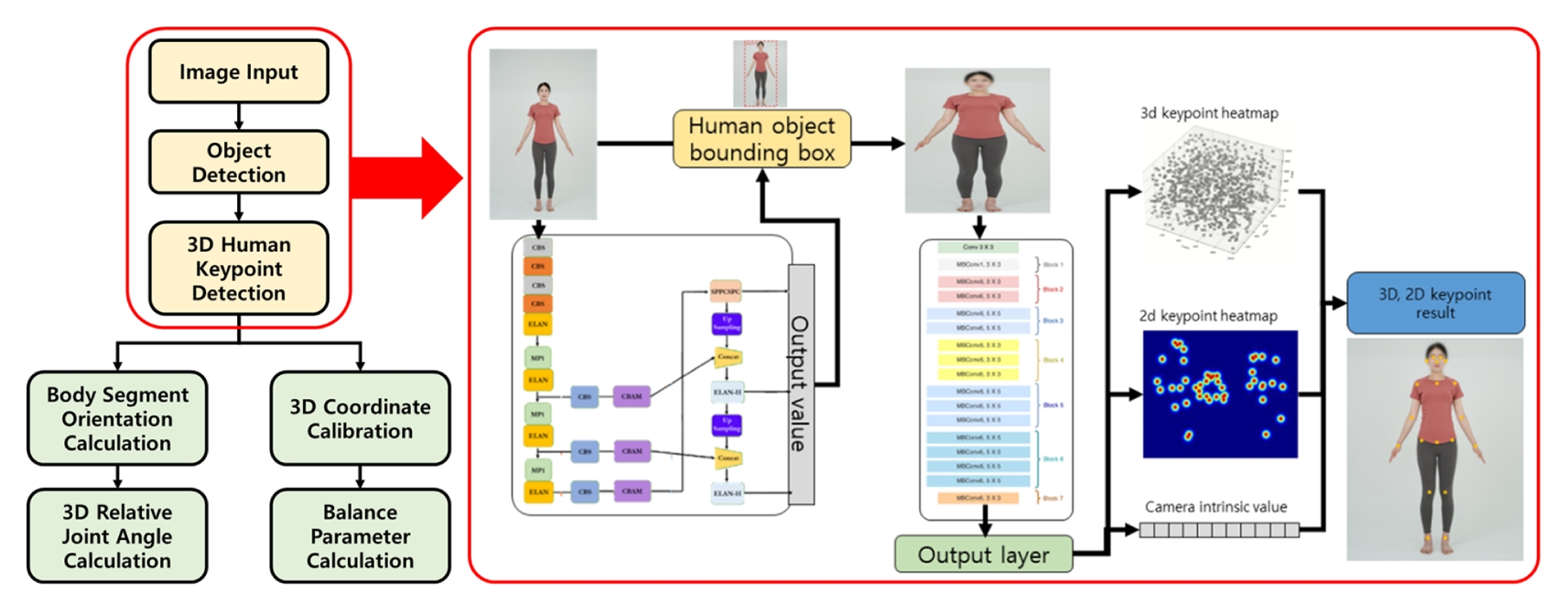

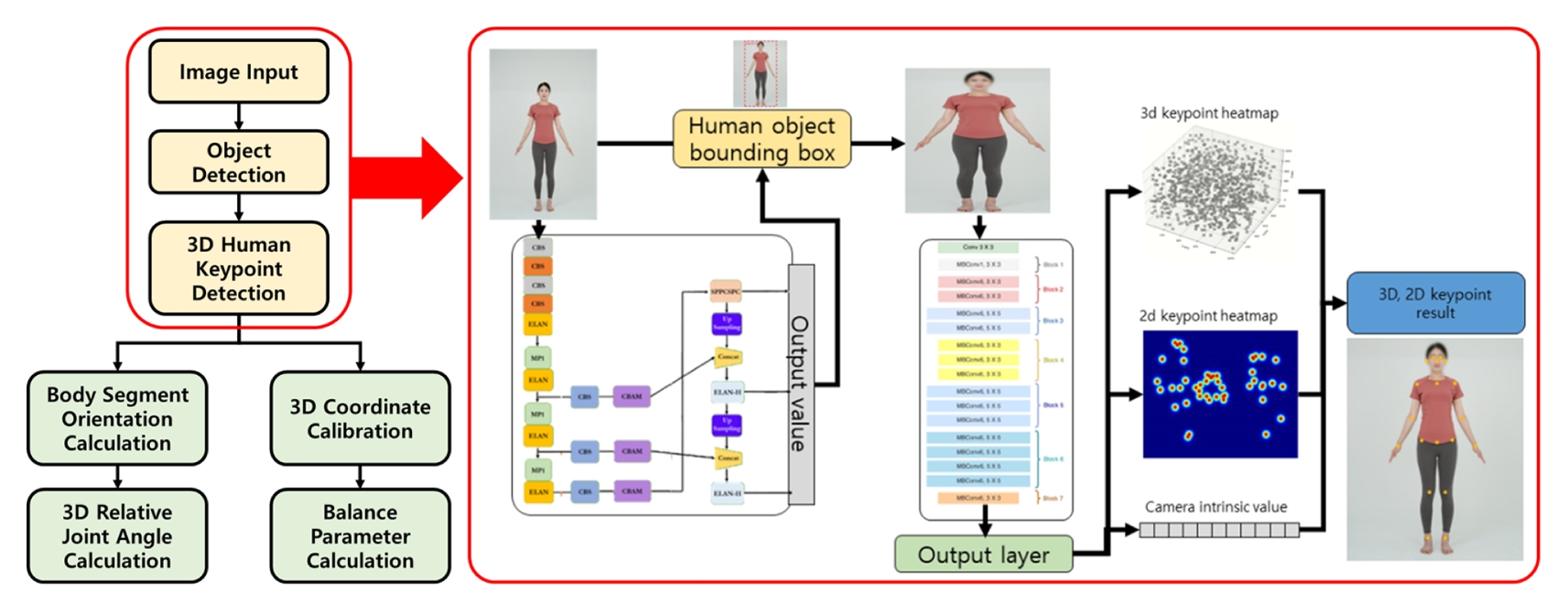

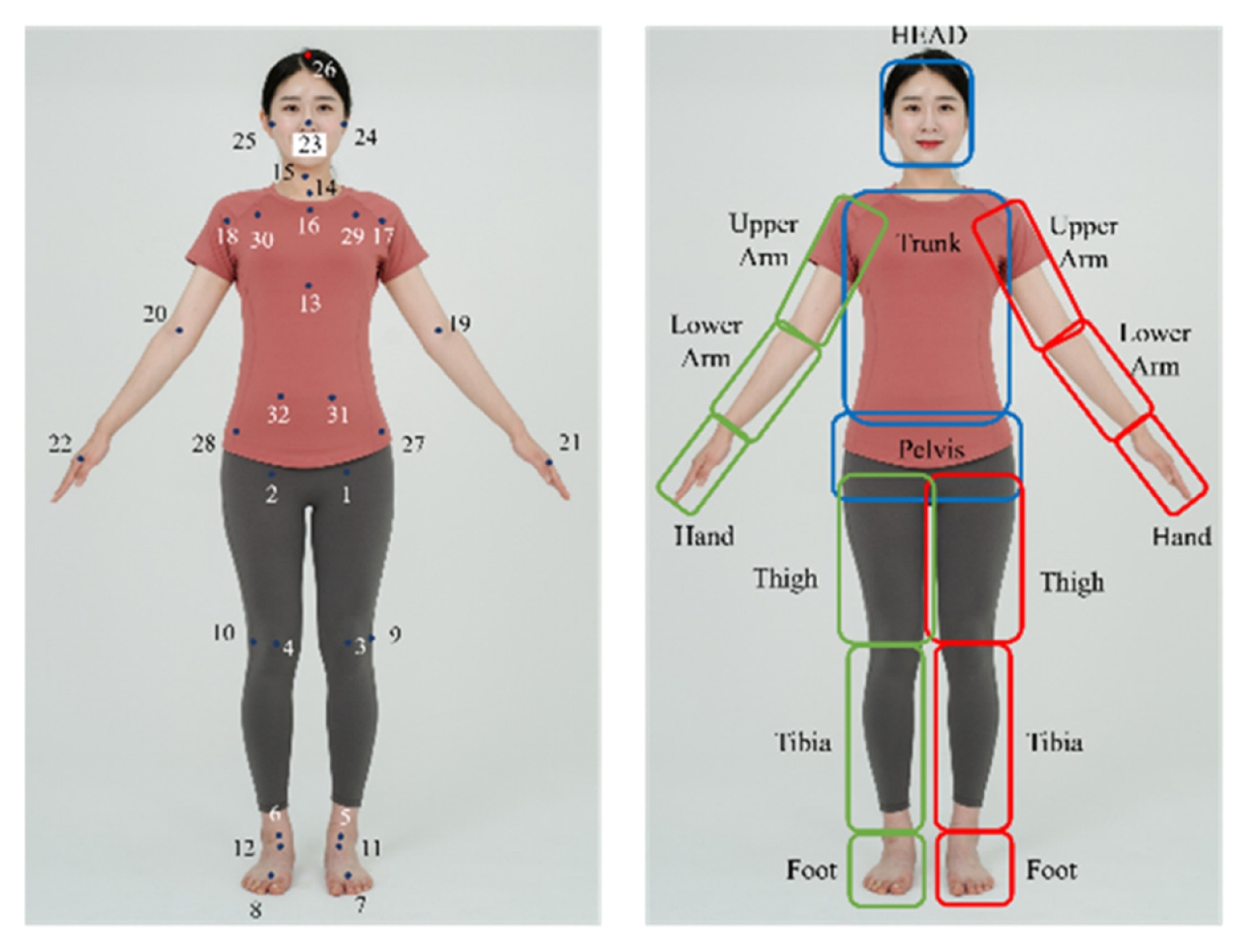

2.2.2 2D 이미지 기반 딥러닝 알고리즘

2D 이미지 촬영은 휴대폰 카메라(Galaxy S23 Ultra, Samsung, Korea)를 사용하였으며, 3,000 × 4,000 픽셀의 JPG 형식으로 저장되었다. 단일 RGB 이미지로부터 3차원 관절 위치를 추정하기 위해 SMPL 기반의 인체 모델[

30]을 사용하였다. 3D 관절 추정에는 METRABS[

31] 기반의 사전 학습된(Pretrained) 모델을 사용하였으며, Human3.6M, COCO 등 공개 데이터셋으로 학습된 공식 파라미터를 그대로 적용하였다. Inference 과정은 입력 이미지를 기반으로 2D Keypoint Heatmap을 생성한 뒤, 모델이 추정한 SMPL 파라미터를 이용해 3차원 관절 좌표를 복원하는 방식으로 이루어진다. 복원된 3D 관절 좌표를 이용하여 본 연구의 9가지 신체 균형 지표를 계산하였다(

Fig. 3).

2.3.1 신체 균형 지표(Balance Parameter)

본 연구에서 사용한 9가지 신체 균형 지표는 임상 자세평가 및 생체역학 연구에서 널리 활용되는 해부학적 기준과 선행 연구를 기반으로 선정하였다. 이들 지표는 촬영 방향에 따라 정면 이미지와 측면 이미지에서 각각 분석되었다.

정면 이미지 분석 지표(Frontal view/ML):

양측 귀 중점과 양측 발 중점을 연결한 선과 수직선에 대한 각도, 전신 좌우 대칭성 평가에 사용되는 기본 정렬 지표[

32,

33]

양측 어깨를 연결한 선의 수평선에 대한 각도, 어깨 비대칭·견갑골 회전 이상과 연관됨[

8,

9]

양측 ASIS를 연결한 선의 수평선에 대한 각도

하지 길이차·측만증·골반 비대칭을 반영함[

32]

양측 무릎을 연결한 선의 수평선에 대한 각도

하지 정렬 비대칭 및 체중 편향 지표[

34,

35]

좌측 대퇴골과 경골이 이루는 각도

우측 대퇴골과 경골이 이루는 각도

* 정형외과적 O다리(O-leg: Varus(+) > 6°) / X다리(X-leg: Valgus(-)> 6°) 기준과 동일함[

36,

37]

측면 이미지 분석 지표 (Sagittal view/AP):

· 거북목(Forward Head Posture (FHP),

Fig. 4(f)):

양측 귀 중점과 C7(융추)수직선에 대한 각도

기본 임상 진단방법으로 널리 활용됨[

38,

39]

목과 고관절을 연결한 선의 수직선에 대한 각도

ASIS와 PSIS를 연결한 선의 수평선에 대한 각도

2.3.2 실험 동작

Fig. 5는 실험동작을 보여준다. 실험 피험자는 해부학적 중립 자세를 약 3초간 유지하였으며, 이 동안 3D 동작 분석 시스템과 2D 이미지 촬영을 통해 데이터를 동시에 수집하였다. 정면 및 측면 이미지를 각각 촬영하여 해당 방향에서 측정 가능한 신체 균형 지표를 분석하였다.

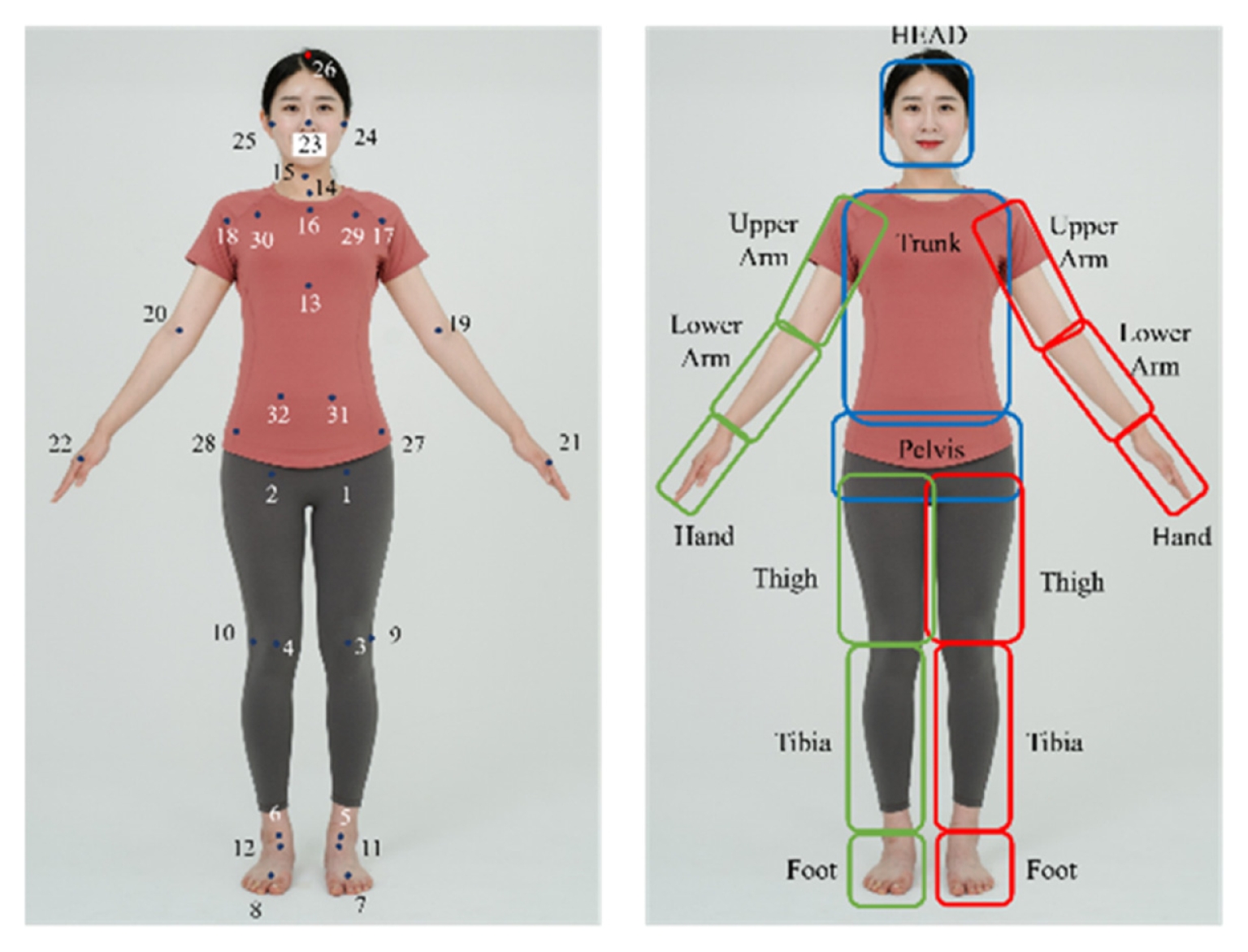

Fig. 4의 오른쪽 그림은 2D 이미지 분석 결과로, 관절 포인트가 붉은 점으로 표시되었다.

2.3.3 신체 균형 지표 계산 과정

Table 1은 Vicon Nexus 1.8.5 내부 연산에 사용된 피험자의 인체 계측 정보를 보여준다. 반사 마커 부착 후, 각 피험자 계측 정보를 활용해 시스템 연산에 따라 LHUP (Left Humerus Proximal)와 RHUP (Right Humerus Proximal), FEP (Femur Proximal)와 FEO (Femur Origin), FEO와 TIO (Tibia Origin)의 6개의 관절 포인트가 추가로 계산되었다. 수평면은 Horizontal Plane (HP, XY-plane), 수직면은 Vertical Plane (VP, XZ-Plane, YZ-Plane)로 정의한다. 아래와 같은 방식으로 신체 균형 지표를 계산한다[

42].

1) Body tilt ML = Angle(MidLEAR, REAR, Foot, HP)

• Foot = MidLANK, RANK, LTOE, RTOE

2) Shoulder tilt = Angle(LHUP, RHUP, HP)

3) Pelvis tilt ML = Angle(LASI, RASI, HP)

4) Knee tilt = Angle(LKNE, RKNE, HP)

5) Left knee varus/valgus = 180° – Angle(LFEP, LFEO, LTIO)

6) Right knee varus/valgus = 180° – Angle(RFEP, RFEO, RTIO)

7) FHP = Angle(MidLEAR, REAR, C7, VP)

8) Body tilt AP = Angle(Neck, Pelvis, VP)

• Pelvis = MidLASI, RASI, LPSI, RPSI

• Neck = MidCLAV, C7

9) Pelvis tilt AP = Angle(MidLASI, RASI, MidLPSI, RPSI, HP)

1) Body tilt ML = Angle(23, Mid7, 8, 11, 12, HP)

2) Shoulder tilt = Angle(29, 30, HP)

3) Pelvis tilt ML = Angle(27, 28, HP)

4) Knee tilt = Angle(9, 10, HP)

5) Left knee varus/valgus = 180° – Angle(1, 3, 5)

6) Right knee varus/valgus = 180° – Angle(2 , 4, 6)

7) FHP = Angle(15, 23, VP)

8) Body tilt AP = Angle(Mid27, 28, 31, 32, 14, VP)

9) Pelvis tilt AP = Angle(Mid27, 28, Mid31, 32, HP)

2.4 분석 방법

3D 동작분석 시스템과 반사 마커를 이용한 분석 방법(3D 방법)으로 얻은 신체 균형 지표와 2D 이미지 기반 딥러닝 알고리즘을 이용한 분석 방법(2D 방법)으로 얻은 신체 균형 지표 결과를 아래와 같은 방법으로 비교한다.

2.4.1 Error Analysis

3D와 2D 방법의 결과를 정량적으로 평가하기 위해 평균 제곱근 오차(RMSE)와 평균 절대 오차(MAE)를 계산하였다. RMSE와 MAE 값이 작을수록 두 방법 간 측정 결과가 차이가 작다고 해석한다[

25]. 또한, 동일 피험자 내에서 두 방법 간 측정값 차이를 검증하기 위해 대응표본 t-검정(Paired t-test)을 수행하였다.

2.4.2 Pearson Correlation Coefficient

두 방법의 측정값 간 상관성을 평가하기 위해 피어슨 상관계수를 계산하였다. 이를 통해 3D 방식과 2D 방식의 측정 결과의 유사성을 분석하였다[

26].

2.4.3 Intraclass and Inter Correlation Coefficient

3D 방법과 2D 방법 각각의 신뢰도를 평가하기 위해, 동일한 조건에서 반복 측정된 데이터를 바탕으로 급내 상관계수(ICC)를 산출하였다. 이는 각 방법 내에서의 일관성을 수치적으로 평가하며, ICC 값이 높을수록 해당 방법이 신뢰할 수 있는 측정 수단임을 의미한다. 또한, 서로 다른 두 방법 간 측정값의 일치도를 평가하기 위해 방법 간 ICC를 추가로 산출하였다. 다만, 두 방법은 측정 방식과 처리 절차에 본질적인 차이를 갖고 있기 때문에, 이 비교는 측정 결과의 정량적 유사성을 파악하기 위해 사용되었다[

27].

2.4.4 Bland-Altman Analysis

3D 방법과 2D 방법 간의 차이를 보완적으로 살펴보기 위해 블랜드–알트만 분석을 적용하였다. 두 방법의 평균 차이(Bias)를 통해 체계적 편향이 있는지를 살펴보고, ±1.96 SD로 설정된 Limits of Agreement (LoA) 안에 측정값이 얼마나 위치하는지를 확인하여 방법 간 일치도를 평가한. Bias의 95% 신뢰구간에 0을 포함하고 대부분의 점이 LoA 범위 내에 존재할 경우, 3D 방법과 2D 방법은 전반적으로 유사한 측정 경향을 보이는 것으로 해석된다[

43,

44].

3. 결과

3.1 3D 및 2D 방법의 신체 균형 지표 결과

Table 3는 3D 방법과 2D 방법의 평균 및 표준편차, 그리고 각 신체 균형 지표의 RMSE와 MAE 값을 보여준다. Pelvis Tilt AP는 3D 방법에서 피험자간 편차가 크게 나타나는 경향을 보인다. FHP, Pelvis Tilt AP를 제외한 다른 신체 균형지표는 3D 방법과 2D 방법 간 RMSE < 5°의 결과를 보였으며, Shoulder Tilt는 RMSE = 0.951°, MAE = 0.744°로 가장 작은 오차를 보였다. 대부분의 신체 균형 지표에서는 3D 방법과 2D 방법간 대응표본 t-검정에서 유의한 차이를 보인다(p < 0.05). 반면, varus/valgus 지표는 두 방법간 차이가 통계적으로 유의하지 않았다(L varus/valgus: p = 0.807, R varus/valgus: p = 0.133).

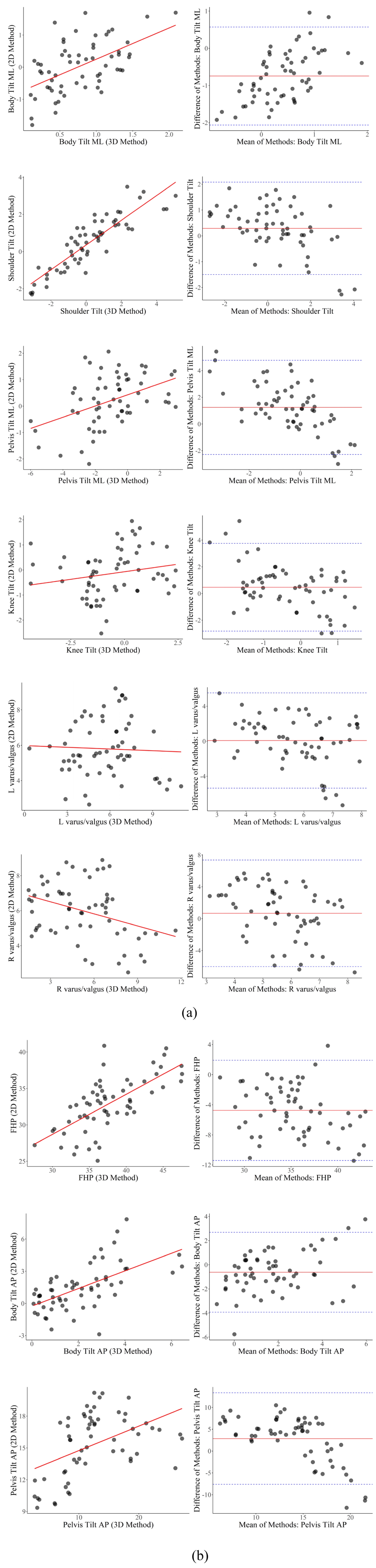

3.2 3D 및 2D 방법의 상관 계수와 일치도 분석

Table 4는 3D 방법과 2D 방법 간의 피어슨 상관계수(r), ICC (2,k), 95% 신뢰구간을 보여준다. 대부분의 신체 균형 지표에서 두 방법 간 r > 0.3 이상의 상관관계를 보였으며, Body Tilt ML, Shoulder Tilt, FHP에서는 r > 0.5로 뚜렷한 선형 상관성이 나타났다. 특히 L varus/valgus의 경우 r = 0.044로 매우 낮은 상관관계를 보였다. ICC(2,k) 결과, Shoulder Tilt, FHP, Body Tilt에서 ICC > 0.7로 높은 일치도를 보였으며, L varus/valgus, Knee Tilt를 제외한 나머지 지표들에서도 ICC > 0.5로 보통 이상의 일치도가 확인되었다.

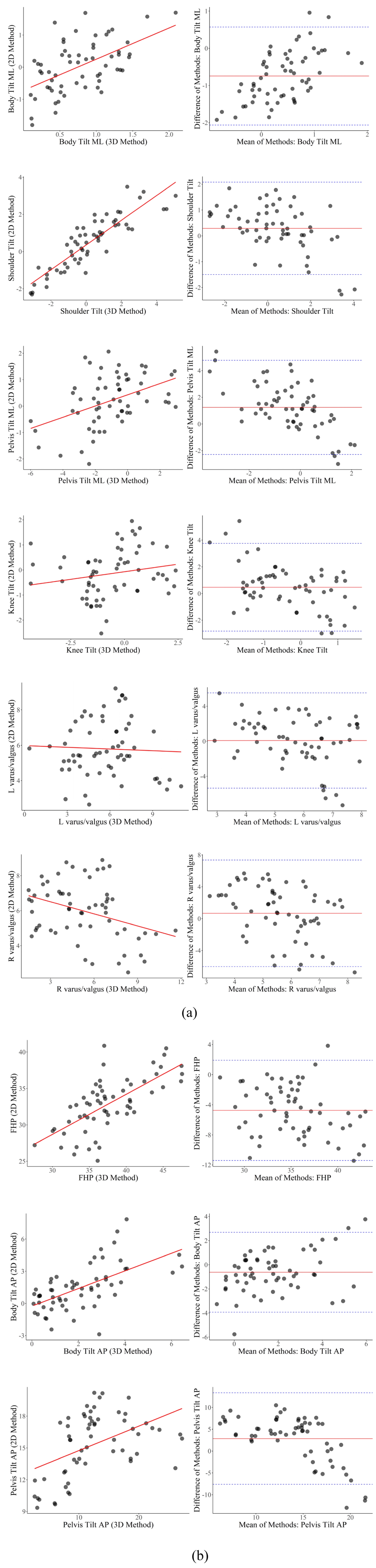

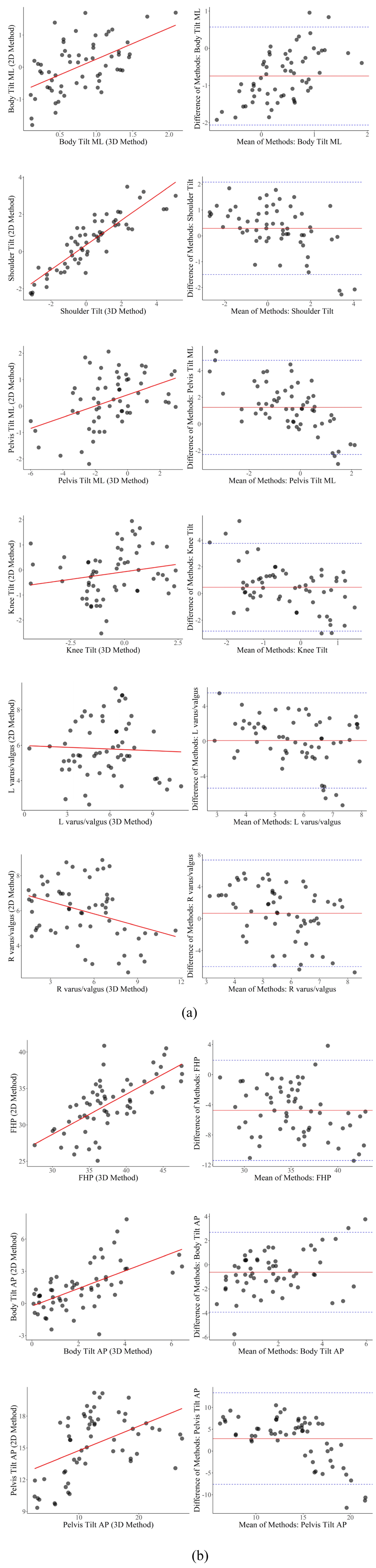

Figs. 7(a)와

7(b)는 3D 방법과 2D 방법 간의 선형 적합 그래프와 블랜드-알트만 그래프를 보여준다.

Figs. 6(a)는 정면 이미지에서 측정한 6개 지표(Body Tilt ML, Shoulder Tilt, Pelvis Tilt ML, Knee Tilt, L/R varus/valgus)의 결과를,

6(b)는 측면 이미지에서 측정한 3개 지표(FHP, Body Tilt AP, Pelvis Tilt AP)의 결과를 나타낸다. 블랜드-알트만 그래프에서 대부분의 측정값이 ±1.96 SD 범위 내에 분포하며, 2D 방법과 3D 방법간 평균 차이는 ±1-3° 범위로 작게 나타났다. 평균차의 95% 신뢰구간이 0을 포함하기에, 대부분의 신체 균형 지표에서 2D 방법과 3D 방법이 양호한 일치도를 보인다. 다만, FHP는 2D 방법이 3D 방법 대비 약 4-5° 정도 일관되게 작게 계산하는 양상을 보이며, Pelvis Tilt AP는 2D 방법이 2 ° 더 크게 계산되는 결과를 보였다.

3.3 3D 및 2D 방법 반복 측정 신뢰도

Table 6와

7는 3D 및 2D 방법 각각의 반복 측정 신뢰도 ICC(2,k)와 95% 신뢰구간을 보여준다. 3D 방법은 모든 지표에서 ICC(2,k) > 0.90으로 매우 높은 신뢰도를 보였으며, 2D 방법 또한 대부분의 지표에서 ICC > 0.80을 기록하며 양호한 수준의 신뢰도를 나타냈다. 특히 Pelvis Tilt AP, FHP 등 일부 지표에서는 2D 방법 역시 0.90 이상의 높은 ICC 값을 보여 3D 방법과 유사한 수준의 일관성을 확인할 수 있었다. 이러한 결과는 2D 분석 방법의 반복 측정 안정성을 보여준다.

4. 토의

본 연구에서는 2 D 이미지 기반 딥러닝 알고리즘을 활용하여 산출된 신체 균형 지표를 3D 동작 분석 시스템을 통해 측정된 결과와 정량적으로 평가하였다. 기존 체형 분석 방식은 전문 측정 장비와 전문가의 개입 및 환경적 제약이 요구되는 반면, 본 실험에 적용된 2 D 분석 방법은 휴대폰 사진과 같은 일반 사진만으로도 간편하게 체형 분석이 가능하다는 장점을 가진다.

20명의 건강한 성인 남성을 대상으로 한 실험에서, Pelvis Tilt AP를 제외한 대부분의 지표에서 2 D 분석 방법의 측정값은 3D 분석 방법보다 작게 나타났다. 3D 분석 방법과 2 D 분석 방법에 따른 신체 균형 지표결과 Body Tilt ML, Shoulder Tilt, Pelvis Tilt ML, Knee Tilt, Body Tilt AP, L varus/valgus는 RMSE와 MAE 둘 다 3° 이하의 오차를 보였으며, 3D 분석 방법과 2D 분석 방법에 따른 신체 균형 지표 결과가 근사함을 보여준다. FHP, Pelvis Tilt AP, R varus/valgus에서는 오차가 10° 미만으로 나타났다. 또한 2 D 방법과 3D 방법 간 측정 결과의 차이는 3D 방법에서 측정되는 관절 좌표와 2 D 방법에서 측정되는 관절좌표가 유사한 위치지만 정확히 같은 포인트를 지칭하고 있지 않은 점에서 나타나는 것으로 보인다. 하지만, 대응표본 t-검정을 수행한 결과, 대부분의 신체 균형 지표는 좌표계 오차로 인해 계산 방법 간 차이를 보이지만 varus/valgus는 통계적으로 유의한 차이를 보이지 않았다. 이는 varus/valgus는 3D 방법과 2D 방법이 유사한 방식으로 계산되었음을 의미한다.

같은 피험자를 대상으로 3D 방법과 2D 방법을 3회씩 측정하였기에, ICC(2,k)를 통해 실험간 반복 측정 신뢰도를 계산했다. 3D 방법의 경우 모든 신체 균형 지표가 ICC > 0.9의 반복 측정 신뢰도를 보였으며, 2D 방법 또한 ICC > 0.8의 반복 측정 신뢰도를 보였다. 신체 균형 지표 계산에서 3D 방법과 마찬가지로, 2D 방법 역시 높은 수준의 반복 측정 신뢰도를 보였다.

또한, 3D 방법과 2D 방법 간 일치도를 분석하기 위해 피어슨 상관계수(r)와 방법 간 ICC(2 ,k)를 계산하였다. Knee Tilt와 Left vargus/valgus를 제외한 대부분의 지표에서 r > 0.3 이상의 뚜렷한 양의 상관관계가 나타났다. 특히 Shoulder Tilt (r = 0.886)와 FHP (r = 0.681)는 높은 상관성을 보였으며, 이는 두 방법 간 결과가 선형적 관계임을 보여준다.

Knee Tilt와 vargus/valgus 등 일부 신체 균형 지표에서 보인 낮은 상관계수와 ICC는 3D 방법과 2D 방법 간 무릎 위치 계산 방식의 차이에서 비롯된 것으로 해석된다. 3D 방법은 반사마커 위치와 신체 치수를 활용하는 반면, 2D 방법은 단일 이미지에서 무릎 위치를 추정하는 과정에서 오차가 발생할 가능성이 크다. 특히 3D 방법의 경우, Szczerbik 등[

15] Fonseca 등[

45]에서 보고된 바와 같이 반사 마커 위치 오차가 신체 균형 지표에 직접적인 영향을 미칠 수 있다. 신체에 반사 마커를 부착할 때, 피부와 골격 사이의 움직임이 최소화된 관절 포인트에 부착한다[

34,

46,

47]. 하지만, 어깨와 무릎과 같이 복합적인 구조로 된 골격과 신체 내부에 위치한 골반의 경우, 해부학적 특징을 잡는 방법은 까다롭다. 이는 선행연구[

48,

49]에서도 보고된 바와 같이, 반사 마커의 위치는 신체 각도 연산에 지대한 영향을 미칠 수 있다. 특히 kadaba 등[

34]은 무릎 각도는 큰 분산을 보이기 때문에 신중히 각도 연산을 해야 한다고 보고했다. 간단한 예시로, 3D 분석에서 FHP를 연산할 때 사용하는 C7 반사 마커는 실제 해부학적 위치보다 피부 표면에서 약 2 cm 정도 돌출된 지점에 부착되기 때문에, 이로 인한 각도 편차가 발생한다. 이러한 점을 고려할 때, 본 연구의 각도 오차에도 해당 영향이 반영되었을 가능성이 있다.

그럼에도,

Figs. 7(a)와

7(b)의 블랜드-알트만 분석 결과, 정면 및 측면 이미지 모두에서 대부분의 측정값이 ±1.96 SD 범위 내에 분포하여 두 방법 간 체계적 편향은 없으며, 신뢰구간에서 0을 포함하여 3D 방법과 2 D 방법간 양호한 일치도를 보였다. 단, FHP와 Pelvis Tilt AP는 일부 편향성이 확인되었다. FHP는 일관적으로 2 D 방법이 3D 방법 대비 약 4-5° 정도 일관되게 작게 계산하는 양상을 보였으며, Pelvis Tilt AP는 3D 방법이 2 ° 정도 크게 계산되는 결과를 보였다. 이는 두 방법 간 일정한 편향을 보이기에, 보정치를 적용하면 충분히 개선 여지가 있다.

또한, 3D 방법과 2 D 방법 간 일치도를 나타내는 ICC(2, k) 분석에서는 Knee Tilt와 Left vargus/valgus를 제외한 대부분의 지표가 ICC ≥ 0.5로 ‘보통’ 이상 수준을 보였으며, Shoulder Tilt (ICC = 0.919)와 FHP (ICC = 0.799)는 높은 일치도를 보였다. 이러한 결과는 제한된 환경에서 반사 마커를 부착해 얻은 3D 분석 결과와 휴대폰으로 얻은 2 D 이미지 분석 결과가 ICC ≥ 0.5의 일치도를 보였다는 점에서, 2D 이미지를 활용한 간편한 체형 분석의 실용성을 시사한다.

특히 정면 이미지에서 측정한 지표들은 양측의 대칭성을 평가하는 데 유용하며, 측면 이미지에서 측정한 지표들은 시상면에서의 자세 정렬을 평가하는 데 중요한 정보를 제공한다. 이는 2D 방법이 다양한 평면에서의 체형 분석에 활용될 수 있음을 시사한다.

본 연구의 한계점은 다음과 같다. 첫째, 20명이라는 제한된 표본 크기로 인해 통계적 검정력이 충분하지 않을 수 있다. 둘째, 건강한 성인 남성만을 대상으로 하여 여성이나 근골격계 질환자에서의 적용 가능성을 확인하지 못했다. 셋째, 정적 자세만을 평가하여 동적 움직임에서의 정확도는 검증하지 못했다.

향후 연구에서는 더 큰 표본과 다양한 인구 집단을 포함한 검증이 필요하며, 신체 균형이 어긋난 상태에서도 측정하여 어긋난 정도를 정확하게 반영하는지 확인할 필요성이 있다.

그럼에도 불구하고 본 연구는 2 D 이미지 기반 체형 분석이 특정 신체 균형 지표 평가에서 3D 동작 분석 시스템을 대체할 수 있는 가능성을 보여주었다. 특히 어깨 기울기, 거북목, 전신 기울기 등의 평가에서는 충분한 정확도를 보여, 원격 의료, 대규모 스크리닝, 일상적인 자세 모니터링 등에 효과적으로 활용될 수 있을 것으로 기대된다.

5. 결론

본 연구에서는 2D 이미지 기반 체형 분석 알고리즘과 3D 동작 분석 시스템을 비교 분석하여, 2D 방법의 정확도와 활용 가능성을 평가하였다. 기존 3D 동작 분석 시스템을 활용한 체형 분석은 높은 정확도를 제공하지만, 비용이 높고 실험실 환경에서만 사용 가능하다는 한계가 있다. 반면, 2D 이미지 기반 체형 분석은 접근성이 뛰어나고, 별도의 마커 없이 일반적인 스마트폰 카메라로 분석이 가능하다는 장점이 있다.

실험 결과, 2D 이미지 기반 분석 방법은 신체 균형 지표를 측정하는 데 있어 3D 방법과 유의미한 상관관계를 보였다. 또한 두 방법간 신뢰도 결과가 ICC > 0.5로 보통 수준 이상의 일치도를 보였으며, 특히 어깨 기울기와 거북목 분석 결과는 높은 수준의 일치도(ICC = 0.919, 0.799)가 확인되었다. 이를 통해 본 연구에 사용된 2 D 분석 방법이 3D 분석 방법과 근사한 결과를 보임을 확인할 수 있었다.

본 연구는 2D 이미지 기반 체형분석 딥러닝 알고리즘의 성능을 3D 동작 분석 시스템과 비교하여 검증한 연구로, 2D 이미지 기반 체형 분석 기술의 실용성과 한계를 평가하였다. 향후 보다 정밀한 데이터 보정을 통해 2 D 이미지 기반 체형 분석 딥러닝 알고리즘의 분석 정확도를 개선하고 다양한 환경에서 검증이 이루어진다면, 보다 정밀하고 신뢰할 수 있는 체형 분석 도구로 발전할 것이다.

FOOTNOTES

-

ACKNOWLEDGEMENT

The reserach was supported by ‘Digital Innovation Company Global Growth Voucher (S-Voucher)’, through the Ministry of Science, ICT and Future Planning (Grant Number) and the Technology development Program (No. 2420023201) funded by the Ministry of SMEs and Startups (MSS, Korea).

Fig. 1

Fig. 2

Fig. 33D estimation from 2D image (REMO)

Fig. 4Calculation method of balance parameters. (a) Body tilt ML, (b) Shoulder tilt, (c) Pelvis tilt ML, (d) Knee tilt, (e) Knee varus/valgus, (f) Forward head posture, (g) Body tilt AP, and (h) Pelvis tilt AP

Fig. 5Experimental procedure. (a) Frontal view, (b) Latcral view

Fig. 6Joint point and segment analysis from 2D image

Fig. 7(a) Linear fit and bland-altman plot (frontal view), (b) Linear fit and bland-altman plot (sagittal view)

Table 1Anthropometric data for 3D motion analysis

Table 1

|

Anthropometric parameter |

Mean ± SD [mm] |

|

Leg length |

888.05 ± 42.94 |

|

Knee width |

115.63 ± 8.66 |

|

Ankle width |

71.6 ± 3.70 |

|

Shoulder offset |

82.43 ± 7.81 |

|

Elow width |

92.83 ± 9.97 |

|

Wrist width |

36.83 ± 4.47 |

Table 2Joint points used in 2D image analysis

Table 2

|

Num |

Joint points |

Num |

Joint points |

|

1 |

Left hip |

17 |

Left shoulder |

|

2 |

Right hip |

18 |

Right shoulder |

|

3 |

Left knee |

19 |

Left elbow |

|

4 |

Right knee |

20 |

Right elbow |

|

5 |

Left ankle |

21 |

Left hand |

|

6 |

Right ankle |

22 |

Right hand |

|

7 |

Left toe |

23 |

Head center |

|

8 |

Right toe |

24 |

Left ear |

|

9 |

Left knee out |

25 |

Right ear |

|

10 |

Right knee out |

26 |

Head top |

|

11 |

Left heel |

27 |

Left ASIS |

|

12 |

Right heel |

28 |

Right ASIS |

|

13 |

Spine |

29 |

Left shoulder blade top |

|

14 |

Neck |

30 |

Right shoulder blade top |

|

15 |

C7 |

31 |

Left PSIS |

|

16 |

Clavicle |

32 |

Right PSIS |

Table 33D and 2D results(unit: °) and RMSE, MAE, p-value

Table 3

|

Balance parameter |

3D method |

2D method |

RMSE |

MAE |

p-value |

|

Body tilt ML |

0.78±0.45 |

0.03±0.80 |

0.999 |

0.838 |

<0.001 |

|

Shoulder tilt |

0.20±1.89 |

0.49±1.42 |

0.951 |

0.744 |

0.016 |

|

Pelvis tilt ML |

−1.04±2.00 |

0.21±0.97 |

2.177 |

1.740 |

<0.001 |

|

Knee tilt |

−0.62±1.58 |

−0.15±0.96 |

1.727 |

1.320 |

0.034 |

|

L varus/valgus |

5.71±2.20 |

5.79±1.60 |

2.753 |

2.149 |

0.807 |

|

R varus/valgus |

5.31±2.48 |

5.98±1.64 |

3.448 |

2.892 |

0.133 |

|

FHP |

37.65±4.57 |

32.01±3.70 |

5.816 |

4.915 |

<0.001 |

|

Body tilt AP |

2.08±1.55 |

1.46±2.09 |

1.788 |

1.408 |

0.006 |

|

Pelvis tilt AP |

12.46±6.06 |

15.31±2.97 |

6.028 |

5.371 |

<0.001 |

Table 4Pearson r, ICC, and 95% CI for 3D and 2D result

Table 4

|

Balance parameter |

r |

ICC(2,k) |

95% CI |

|

Body tilt ML |

0.544 |

0.633 |

[0.386, 0.781] |

|

Shoulder tilt |

0.886 |

0.919 |

[0.865, 0.952] |

|

Pelvis tilt ML |

0.439 |

0.523 |

[0.184, 0.709] |

|

Knee tilt |

0.199 |

0.300 |

[−0.172, 0.582] |

|

L varus/valgus |

0.044 |

0.081 |

[−0.539, 0.451] |

|

R varus/valgus |

0.349 |

0.486 |

[0.139, 0.693] |

|

FHP |

0.681 |

0.799 |

[0.665, 0.881] |

|

Body tilt AP |

0.606 |

0.734 |

[0.555, 0.841] |

|

Pelvis tilt AP |

0.468 |

0.541 |

[0.232, 0.726] |

Table 5Bias and limits of agreement from bland-altman plot

Table 5

|

Balance parameter |

Bias |

LoA |

|

Body tilt ML |

−0.745 |

[−2.063, 0.573] |

|

Shoulder tilt |

0.291 |

[−1.498, 2.080] |

|

Pelvis tilt ML |

1.245 |

[−2.287, 4.776] |

|

Knee tilt |

0.469 |

[−2.817, 3.755] |

|

L varus/valgus |

0.088 |

[−5.351, 5.526] |

|

R varus/valgus |

0.671 |

[−6.015, 7.357] |

|

FHP |

−4.741 |

[−11.40, 1.919] |

|

Body tilt AP |

−0.62 |

[−3.935, 2.695] |

|

Pelvis tilt AP |

2.86 |

[−7.629, 13.34] |

Table 6Repeated-measures ICC(2,k) for the 3D method

Table 6

|

Balance parameter |

ICC(2,k) |

95% CI |

|

Body tilt ML |

0.907 |

[0.805, 0.960] |

|

Shoulder tilt |

0.985 |

[0.968, 0.994] |

|

Pelvis tilt ML |

0.994 |

[0.987, 0.997] |

|

Knee tilt |

0.996 |

[0.992, 0.998] |

|

L varus/valgus |

0.964 |

[0.923, 0.984] |

|

R varus/valgus |

0.959 |

[0.914, 0.983] |

|

FHP |

0.971 |

[0.939, 0.988] |

|

Body tilt AP |

0.968 |

[0.932, 0.986] |

|

Pelvis tilt AP |

0.992 |

[0.983, 0.997] |

Table 7Repeated-measures ICC(2,k) for the 2D method

Table 7

|

Balance parameter |

ICC(2,k) |

95% CI |

|

Body tilt ML |

0.811 |

[0.602, 0.919] |

|

Shoulder tilt |

0.900 |

[0.789, 0.957] |

|

Pelvis tilt ML |

0.845 |

[0.673, 0.934] |

|

Knee tilt |

0.816 |

[0.612, 0.921] |

|

L varus/valgus |

0.991 |

[0.982, 0.996] |

|

R varus/valgus |

0.981 |

[0.961, 0.992] |

|

FHP |

0.962 |

[0.920, 0.984] |

|

Body tilt AP |

0.950 |

[0.895, 0.979] |

|

Pelvis tilt AP |

0.953 |

[0.900, 0.980] |

REFERENCES

- 1. Kim, H. S., Lee, H. K., (2022), The deepening of colonization of leisure by smartphones before and after COVID-19: Focusing on the national leisure activity survey and the korean media panel survey, Culture and Convergence, 44(5), 139-163.

- 2. Parihar, JKS, Jain, V. K., Chaturvedi, P., Kaushik, J., Jain, G., Parihar, A. K., (2016), Computer and visual display terminals (VDT) vision syndrome (CVDTS), Medical Journal Armed Forces India, 72(3), 270-276.

- 3. Health Insurance Review & Assessment Service, One out of three people in Korea receives treatment for musculoskeletal disorders. https://www.hira.or.kr/bbsDummy.do?pgmid=HIRAA020041000100&brdScnBltNo=4&brdBltNo=10167

- 4. Park, JS, Park, CH, Song, YK, (2015), Research of body parameters characteristics from posture analysis of musculoskeletal problem patient, Journal of Korea CHUNA Manual Medicine for Spine and Nerves, 10(1), 47-61.

- 5. Hong, W., (2024), Advances and opportunities of mobile health in the postpandemic era: Smartphonization of wearable devices and wearable deviceization of smartphones, JMIR mHealth and uHealth, 12, e48803.

- 6. He, Y., Xie, Z., Li, J., Meng, Z., Xue, D., Hao, C., (2024), Global trends in mHealth and medical education research: Bibliometrics and knowledge graph analysis, JMIR Medical Education, 10, e52461.

- 7. Statista Market Insights, (2023), Digital health. https://www.statista.com/outlook/hmo/digital-health/worldwide

- 8. Magarey, M. E., Jones, M. A., (2003), Dynamic evaluation and early management of altered motor control around the shoulder complex, Manual Therapy, 8(4), 195-206.

- 9. Magarey, M. E., Jones, M. A., (2003), Specific evaluation of the function of force couples relevant for stabilization of the glenohumeral joint, Manual Therapy, 8(4), 247-253.

- 10. Hindle, K. B., Whitcomb, T. J., Briggs, W. O., Hong, J., (2012), Proprioceptive neuromuscular facilitation (PNF): Its mechanisms and effects on range of motion and muscular function, Journal of Human Kinetics, 31, 105-113.

- 11. Smith, B., Ashton, K. M., Bohl, D., Clark, R. C., Metheny, J. B., Klassen, S., (2006), Influence of carrying a backpack on pelvic tilt, rotation, and obliquity in female college students, Gait & Posture, 23(3), 263-267.

- 12. Shingai, M., Niijima, R., Kobayashi, Y., Murayama, A., Miyadera, R., Mukai, S., (2020), Quantitative evaluation of subjective posture recognition by physiotherapists using a 3D motion capture, Journal of Physical Therapy Science, 32(8), 510-515.

- 13. Brink, Y., Louw, Q., Grimmer, K., Schreve, K., Van der Westhuizen, G., Jordaan, E., (2013), Development of a cost effective three-dimensional posture analysis tool: Validity and reliability, BMC Musculoskeletal Disorders, 14(1), 335.

- 14. Longo, U. G., De Salvatore, S., Carnevale, A., Tecce, S. M., Bandini, B., Lalli, A., Denaro, V., (2022), Optical motion capture systems for 3D kinematic analysis in patients with shoulder disorders, International Journal of Environmental Research and Public Health, 19(19), 12033.

- 15. Szczerbik, E., Kalinowska, M., (2011), The influence of knee marker placement error on evaluation of gait kinematic parameters, Acta of Bioengineering and Biomechanics, 13(3), 43-46.

- 16. Plagemann, C., Ganapathi, V., Koller, D., Thrun, S., (2010), Real-time identification and localization of body parts from depth images, Proceedings of the IEEE International Conference on Robotics and Automation, 3108-3113.

- 17. Jin, H., He, X., Wang, L., Zhu, Y., Jiang, W., Zhou, X., (2025), SitPose: Real-time detection of sitting posture and sedentary behavior using ensemble learning with depth sensor, IEEE Sensors Journal, 25(7), 12444-12454.

- 18. Pece, F., Kautz, J., Weyrich, T., (2011), Three depth-camera technologies compared, Proceedings of the First BEAMING Workshop.

- 19. Stamm, O., Heimann-Steinert, A., (2020), Accuracy of monocular two-dimensional pose estimation compared with a reference standard for kinematic multiview analysis: Validation study, JMIR mHealth and uHealth, 8(12), e19608.

- 20. Lee, N., Choi, Y., Park, S., Son, J., (2021), A body shape change tracking service using deep learning-based human part segmentation technology, Proceedings of the Korea IT Service Society Conference, 701-704.

- 21. Li, P., Xu, Y., Wei, Y., Yang, Y., (2020), Self-correction for human parsing, IEEE Transactions on Pattern Analysis and Machine Intelligence, 44(6), 3260-3271.

- 22. Liang, X., Gong, K., Shen, X., Lin, L., (2018), Look into person: Joint body parsing and pose estimation network and a new benchmark, IEEE Transactions on Pattern Analysis and Machine Intelligence, 41(4), 871-885.

- 23. Liang, X., Liu, S., Shen, X., Yang, J., Liu, L., Dong, J., Lin, L., Qiao, Y., Yan, S., (2015), Deep human parsing with active template regression, IEEE Transactions on Pattern Analysis and Machine Intelligence, 37(12), 2402-2414.

- 24. Chen, X., Mottaghi, R., Liu, X., Fidler, S., Urtasun, R., Yuille, A., (2014), Detect what you can: Detecting and representing objects using holistic models and body parts, Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 1971–1978.

- 25. Hodson, T. O., (2022), Root mean square error (RMSE) or mean absolute error (MAE): When to use them or not, Geoscientific Model Development Discussions, 15(14), 15481-548.

- 26. Cohen, I., Huang, Y., Chen, J., Benesty, J., (2009), Noise reduction in speech processing. Springer.

- 27. Koo, T. K., Li, M. Y., (2016), A guideline of selecting and reporting intraclass correlation coefficients for reliability research, Journal of Chiropractic Medicine, 15(2), 155-163.

- 28. Davis, R. B. III, Ounpuu, S., Tyburski, D., Gage, J. R., (1991), A gait analysis data collection and reduction technique, Human Movement Science, 10(5), 575-587.

- 29. Vicon Motion System Ltd, (2024), Plug-in gait reference guide. https://help.vicon.com/space/Nexus216/11607059

- 30. Loper, M., Mahmood, N., Romero, J., Pons-Moll, G., Black, M. J., (2023), SMPL: A skinned multi-person linear model, Seminal Graphics Papers: Pushing the Boundaries, 2, 851-866.

- 31. Sárándi, I., Linder, T., Arras, K. O., Leibe, B., (2020), Metrabs: Metric-scale truncation-robust heatmaps for absolute 3D human pose estimation, IEEE Transactions on Biometrics, Behavior, and Identity Science, 3(1), 16-30.

- 32. Smith, B., Ashton, K. M., Bohl, D., Clark, R. C., Metheny, J. B., Klassen, S., (2006), Influence of carrying a backpack on pelvic tilt, rotation, and obliquity in female college students, Gait & Posture, 23(3), 263-267.

- 33. Brink, Y., Louw, Q., Grimmer, K., Schreve, K., Van der Westhuizen, G., Jordaan, E., (2013), Development of a cost effective three-dimensional posture analysis tool: Validity and reliability, BMC Musculoskeletal Disorders, 14, 335.

- 34. Kadaba, M. P., Ramakrishnan, H. K., Wootten, M. E., (1990), Measurement of lower extremity kinematics during level walking, Journal of Orthopaedic Research, 8(3), 383-392.

- 35. Leardini, A., Sawacha, Z., Paolini, G., Ingrosso, S., Nativo, R., Benedetti, M. G., (2007), A new anatomically based protocol for gait analysis in children, Gait & Posture, 26(4), 560-571.

- 36. Cooke, D., Scudamore, A., Li, J., Wyss, U., Bryant, T., Costigan, P., (1997), Axial lower-limb alignment: Comparison of knee geometry in normal volunteers and osteoarthritis patients, Osteoarthritis and Cartilage, 5(1), 39-47.

- 37. Bellemans, J., Colyn, W., Vandenneucker, H., Victor, J., (2012), The Chitranjan Ranawat Award: Is neutral mechanical alignment normal for all patients?: The concept of constitutional varus, Clinical Orthopaedics and Related Research, 470(1), 45-53.

- 38. Sawyer, Q. L., (2006), Effects of forward head rounded shoulder posture on shoulder girdle flexibility, range of motion, and strength, M.Sc. Thesis, The University of North Carolina; Chapel Hill.

- 39. Migliarese, S., White, E., (2019), Review of forward-head posture and vestibular deficits in older adults, Current Geriatrics Reports, 8(3), 194-201.

- 40. Shingai, M., Niijima, R., Kobayashi, Y., Murayama, A., Miyadera, R., Mukai, S., (2020), Quantitative evaluation of subjective posture recognition by physiotherapists using a 3D motion capture, Journal of Physical Therapy Science, 32(8), 510-515.

- 41. Neumann, D. A., (2009), Kinesiology of the musculoskeletal system: Foundations for rehabilitation, 2nd Edition, Mosby Elsevier.

- 42. Van Crombrugge, I., Sels, S., Ribbens, B., Steenackers, G., Penne, R., Vanlanduit, S., (2022), Accuracy assessment of joint angles estimated from 2D and 3D camera measurements, Sensors, 22(5), 1729.

- 43. Bunce, C., (2009), Correlation, agreement, and Bland–Altman analysis: Statistical analysis of method comparison studies, American Journal of Ophthalmology, 148(1), 4-6.

- 44. Giavarina, D., (2015), Understanding Bland-Altman analysis, Biochemia Medica, 25(2), 141-151.

- 45. Fonseca, M., Bergere, M., Candido, J., Leboeuf, F., Dumas, R., Armand, S., (2022), The conventional gait model’s sensitivity to lower-limb marker placement, Scientific Reports, 12(1), 14207.

- 46. Cappozzo, A., Della Croce, U., Leardini, A., Chiari, L., (2005), Human movement analysis using stereophotogrammetry: Part 1: Theoretical background, Gait & Posture, 21(2), 186-196.

- 47. Chiari, L., Della Croce, U., Leardini, A., Cappozzo, A., (2005), Human movement analysis using stereophotogrammetry: Part 2: Instrumental errors, Gait & Posture, 21(2), 197-211.

- 48. Leardini, A., Sawacha, Z., Paolini, G., Ingrosso, S., Nativo, R., Benedetti, M. G., (2007), A new anatomically based protocol for gait analysis in children, Gait & Posture, 26(4), 560-571.

- 49. Wang, JP, Wang, SH, Wang, YQ, Hu, H., Yu, J. W., Zhao, X., Ding, X., Li, Y., (2021), A data process of human knee joint kinematics obtained by motion-capture measurement, BMC Medical Informatics and Decision Making, 21(1), 121.

Biography

- Seonggeon Pyo

B.Sc. in the Department of Mechanical Engineering, Yonsei University. His research interests are biomechanics, pain prediction, and cognitive science.

- Gildong Choi

B.Sc. candidate in the Department of Mechanical Engineering, Yonsei University. His research interest is biomechanics.

- Seunghee Lee

M.S. in the Department of Biomedical Engineering, Yonsei University. His research interests are biomechanics, elderly fall detection, risk prediction, data augmentation and AI.

- Youngho Kim

Professor in the Department of Biomedical Engineering, Yonsei University. His research interests are musculoskeletal biomechanics and rehabilitation engineering.

- Jungyoon Kim

CTO at REMO Inc. His research interests include 2D image AI, deep learning-based posture analysis and motion analysis.

- Eunkyung Bae

CEO at REMO Inc. Her research interests include deep learning-based 2D posture analysis and digital healthcare.